Die Architektur der Vergesslichkeit: Warum deine KI nach 20 Prompts “Dumm” wird und wie du das System überlistest

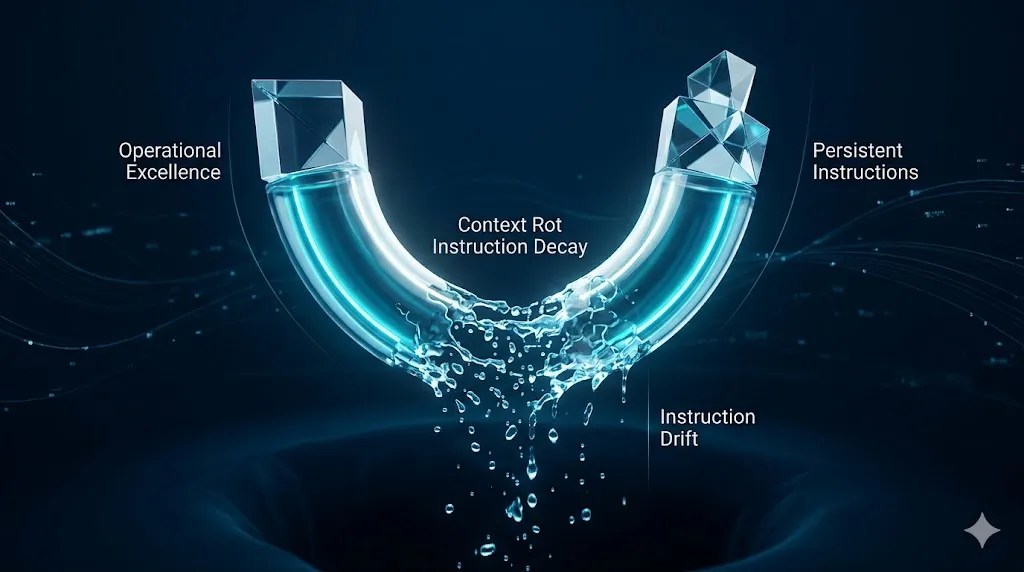

In der operativen Realität des Jahres 2026 stehen Marketing-Entscheider vor einem Paradoxon: Während Anbieter wie Google und OpenAI Kontextfenster von über einer Million Token bewerben, zerfallen komplexe Strategien in langen Chats oft schon nach wenigen Interaktionen. Dieses Phänomen, in der Fachwelt als Context Degradation Syndrome (CDS) oder schlicht Context Rot bekannt, ist kein Software-Bug, sondern ein fundamentales Merkmal der Transformer-Architektur.

Diagnostische Analyse: Die 4Cs der kontextuellen Erosion

Die folgende Tabelle dekonstruiert die Auswirkungen der KI-Amnesie auf die strategischen Säulen Ihres Unternehmens:

| Dimension | Diagnostischer Befund | Strategisches Risiko |

|---|---|---|

| Customer | 83 % der Konsumenten erkennen KI-Inhalte; Inkonsistenzen durch Context Drift zerstören das Vertrauen sofort. | Vertrauensverlust führt zu sinkenden Konversionsraten im mittleren Funnel. |

| Category | Der Wettbewerb verlagert sich von der Content-Menge hin zur “Agentic Excellence” und Marken-Souveränität. | Marken ohne strikte KI-Governance versinken in der algorithmischen Beliebigkeit . |

| Company | 65 % der Enterprise-KI-Fehler im Jahr 2025 basierten auf dem Verlust des roten Fadens bei Multi-Step-Aufgaben. | Massive operative Ineffizienz durch redundante Korrekturschleifen und Retries. |

| Culture | Die Erwartung an “Always-on”-Expertise steigt; statische Marketingpläne werden durch liquide Systeme ersetzt. | Verlust der authentischen Markenstimme (AI Brand Drift) . |

Das Omni-Liquid GEM Framework: Strategien gegen den Daten-Verfall

Um die Generative Excellence Ihrer Marke sicherzustellen, muss das Chat-Management von einer naiven Konversation zu einer kybernetischen Systemsteuerung transformiert werden.

1. Generative Relevanz: Den Proof-of-Expertise sichern

In einer Welt von AI-Overviews und LLM-basierten Empfehlungen ist Konsistenz die neue Währung. Wenn Ihre KI im Chatverlauf Instruktionen “vergisst”, produziert sie generischen Output, der Ihre Marke als glaubwürdige Entität entwertet. Die systemische Analyse impliziert zwingend, dass nur eine strikte Kontext-Hygiene die Zitierfähigkeit Ihrer Inhalte in LLMs sicherstellt.

2. Operational Excellence: Modulare Prompt-Architektur

Die Forschung zeigt, dass monolithische Prompts (Gems/CustomGPTs) unter dem Lost in the Middle-Phänomen leiden: Informationen in der Mitte des Kontextes werden mathematisch untergewichtet. Die Lösung liegt in der Trennung von Identität und Aufgabe.

| Modul-Typ | Funktion | Inhaltliche Parameter |

|---|---|---|

| Role Module | Permanente Identität | Tonalität, Logik-Stil (z. B. “skeptischer Analyst”), ethische Leitplanken, Markenstimme. |

| Mission Module | Temporäre Aufgabe | Aktuelles Ziel (z. B. “SEO-Audit”), spezifische Datenquellen, gewünschtes Output-Format. |

3. Monetarisierung & Habituisierung: Effizienz durch Kontext-Steuerung

Lange Kontexte verursachen exponentielle Kosten und Latenzen. Durch Techniken wie Context Compaction (Zusammenfassung der Historie) und Prompt Caching lassen sich die API-Kosten um bis zu 90 % senken, während die Präzision erhalten bleibt.

Operative Handlungsableitung: Das Capture-Create-Convert System

Das Framework impliziert drei konkrete Schritte, um KI-Chats professionell zu skalieren:

Capture Demand: Strategie des “Clean Context”

Behandeln Sie Chats nicht als endlose Konversation, sondern als isolierte Task-Instanzen. Sobald ein Meilenstein erreicht ist, sollte die KI eine Zusammenfassung (State-Handoff) erstellen. Starten Sie danach einen neuen Chat mit dieser Zusammenfassung als Basis-Prompt, um den “RLHF Gravity Well” (den Sog der KI zurück zu höflichen, aber vagen Standard-Antworten) zu vermeiden .

Create Demand: Implementierung externer Gedächtnisschichten

Für langfristige Projekte ist die Nutzung von Tools wie Mem0, Letta oder Zep alternativlos. Diese Frameworks lagern Fakten und Präferenzen in externe Datenbanken aus und laden sie “Just-in-Time” in den Chat-Kontext . Dies ermöglicht effektiv unendliche Konversationen ohne Qualitätsverlust.

Convert Demand: Runtime Reinforcement (Sticky Notes)

Nutzen Sie den Recency Bias der Modelle zu Ihrem Vorteil. Das Framework sieht vor, geschäftskritische Regeln (z. B. “Niemals Emojis verwenden”) nicht nur am Anfang, sondern als “Sticky Note” am Ende jeder Nutzeranfrage erneut einzuspielen. Dies zwingt die Aufmerksamkeit der KI Millisekunden vor der Generierung zurück auf die Brand Governance.

Operative Checkliste für phoenixseo.de-Leser

-

Stoppen Sie Endlos-Chats; nutzen Sie das GSD-Prinzip (Get Clear, Sprint, Done).

-

Ersetzen Sie vage Personas durch operative Prinzipien (z. B. “Beweis vor Erzählung”).

-

Nutzen Sie Markdown-Trenner und nummerierte Listen zur Erhöhung der logischen Stabilität.

-

Implementieren Sie einen “Dissent-Trigger” (z. B.

D_A:für Devil’s Advocate), um automatisierte Höflichkeit zu unterbrechen.

Die systemische Analyse macht deutlich: Context Engineering ist im Jahr 2026 keine IT-Aufgabe, sondern eine Kernkompetenz der strategischen Markenführung. Wer den Kontext beherrscht, beherrscht die KI.